Entwicklung

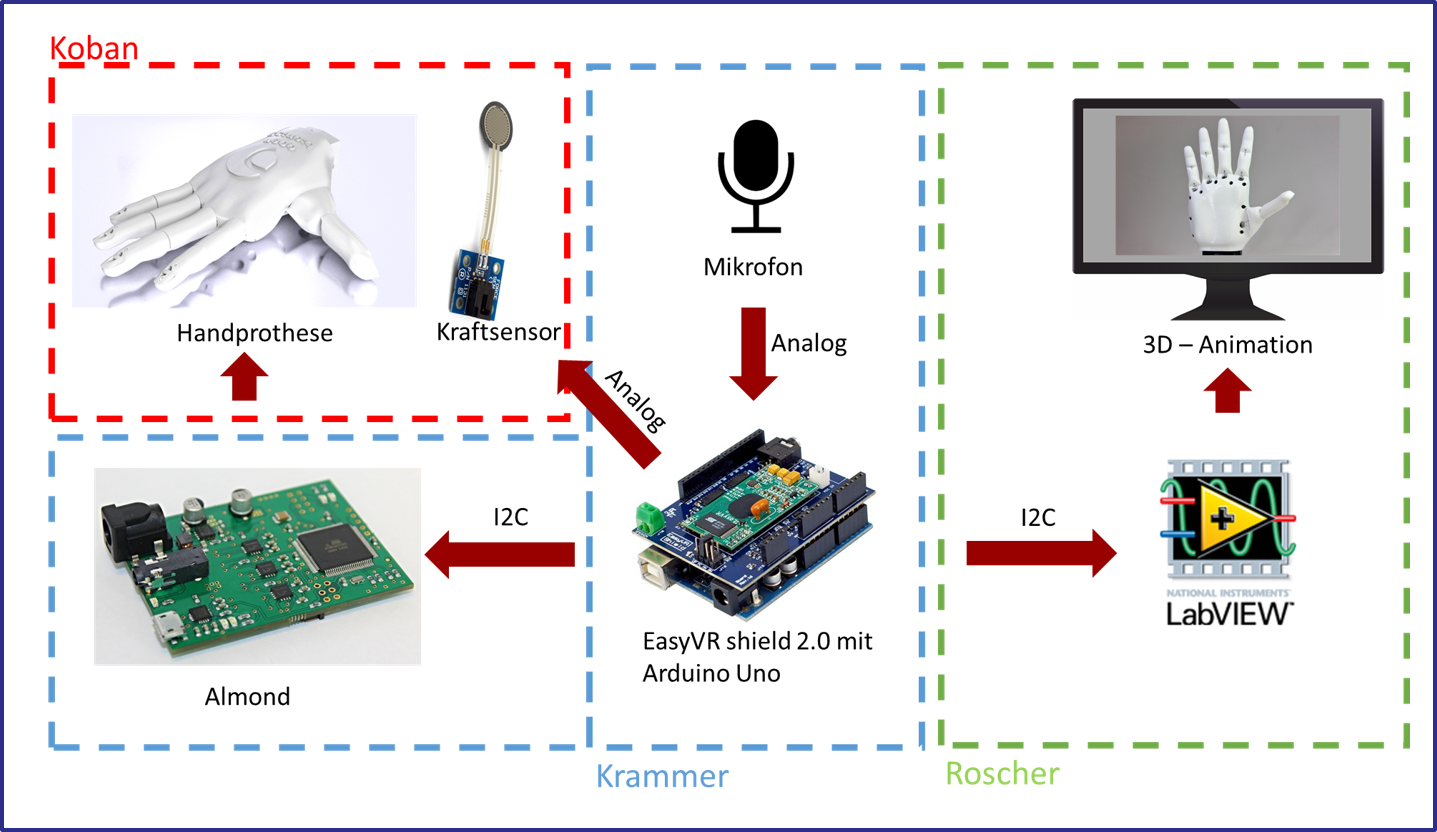

Die Handprothese nimmt über ein Mikrophon definierte Sprachbefehle auf. Diese werden in der Arduino IDE verarbeitet

und über I2C Kommunikation an den Motorcontroller in der Handfläche weitergeleitet.

Die Handprothese selbst besitzt einen Kraftsensor. Dieser soll der Prothese Feinfühligkeit verleihen. Der Kraftsensor

übermittelt seine Daten wiederum dem Arduino-Board, wo sie weiterverarbeitet werden.

Zusätzlich werden die Daten vom Motorcontroller über den Arduino via I2C an LabVIEW geschickt.

Mit Hilfe dieser Daten wird in LabVIEW eine synchron zur Handprothese ablaufende 3D-Animation erstellt.

Klicken zum Vergrößern

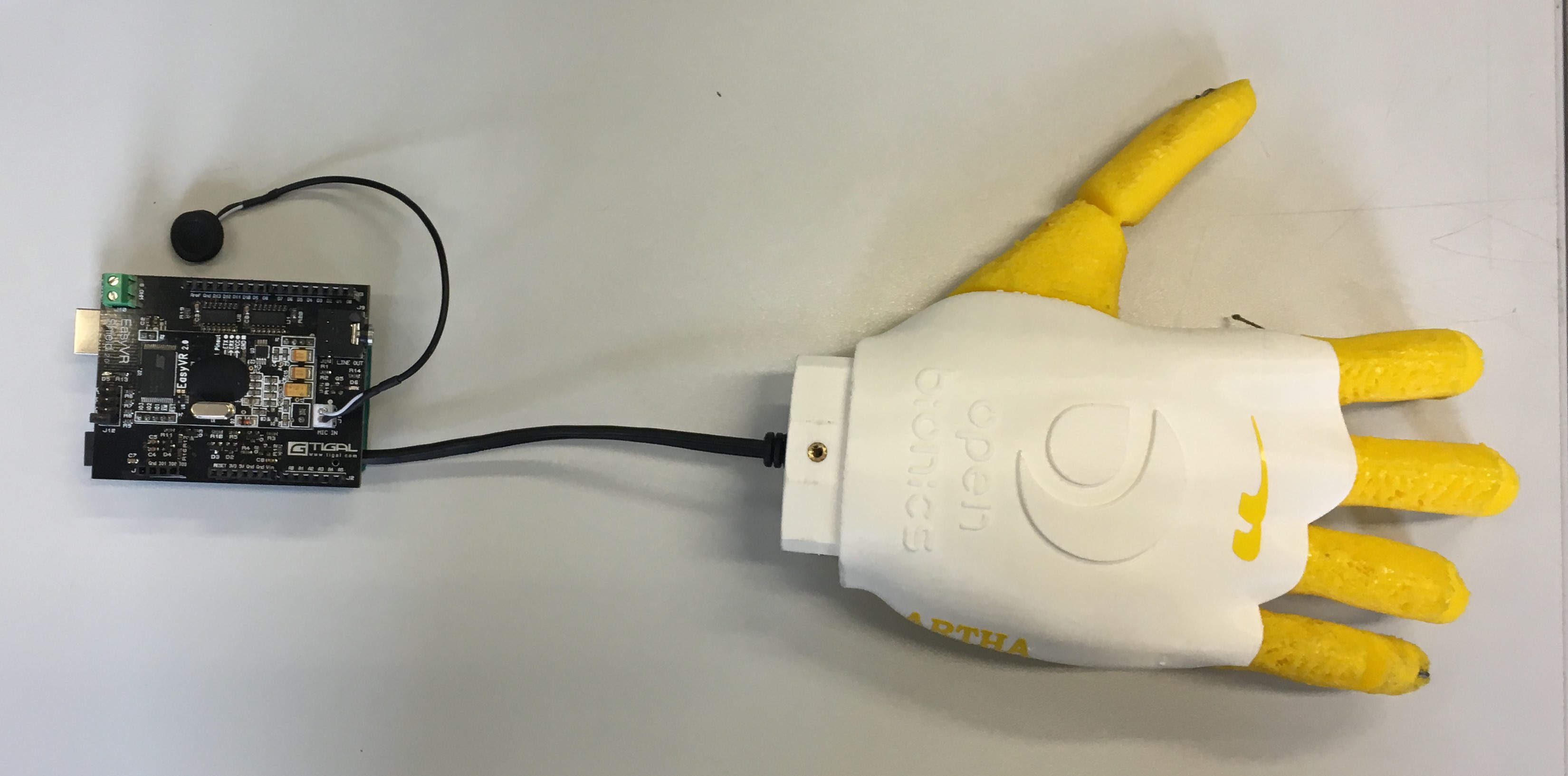

Arduino-Board und EasyVR Shield 2.0

Das EasyVR Shield 2.0 dient zur Aufnahme und Verarbeitung der Sprachbefehle.

Mit einem Programm von EasyVR werden die Sprachbefehle definiert und antrainiert, damit die Software speziell auf diese Sprachbefehle reagiert.

Das EasyVR Shield 2.0 ist eine Huckepackplatine für den Arduino Uno. Wird ein Sprachbefehl erkannt, verarbeitet dieser den Befehl und

leitet ihn über I2C-Kommunikation an den Motorcontroller weiter.

Der Motorcontroller nennt sich „Almond“ und ist zwar kein Arduino-Board,

besitzt aber einen typischen Arduino-IC, den ATMega2550. Das Almond erhält Befehle und wandelt diese in Motoraktionen um.

|

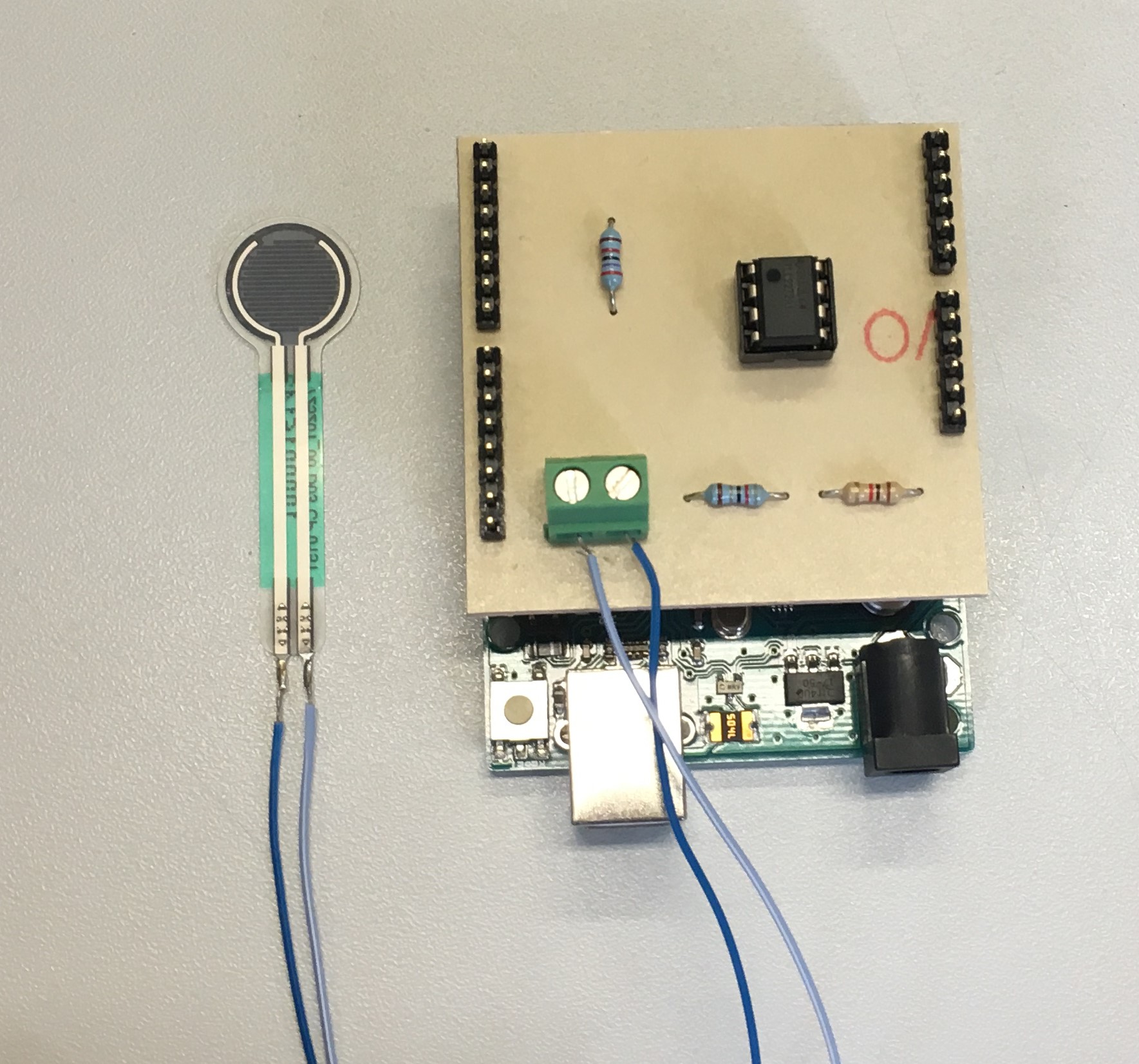

Kraftsensor FSR151

Mit dem FSR 151 wird die Sensibilität der Prothese realisiert. Das Arduino-Board bekommt vom Sensor, belastungsabhängig, Voltwerte von 0-5V. Arduino liefert den passenden Kraftwert und verarbeitet diesen weiter in Positionsdaten. Der vom Sensor gemessene Voltwert bestimmt nun, abhängig von der Höhe des Wertes, die Position der Motoren und somit den Griff der Hand.

|

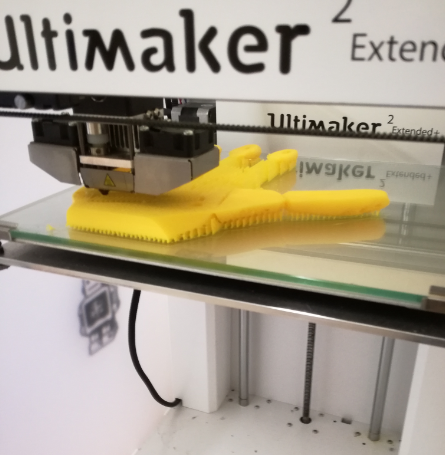

Handprothese

Die Prothese wird mit dem Ultimaker 2+ gedruckt. Die Materialien, die dafür benötigt werden, sind herkömmliches PLA

für den Handrücken, und Ninjaflex, das die Bewegung der Fingerglieder ermöglicht.

Für den Zusammenhalt der Prothesenteile sorgen Gewindeschrauben an den äußeren Flächen der Hand.

In den Fingern gespannte Tendolines, die mit den Motoren verbunden sind, sind verantwortlich dafür,

dass sich die Fingerglieder beugen und strecken.

|

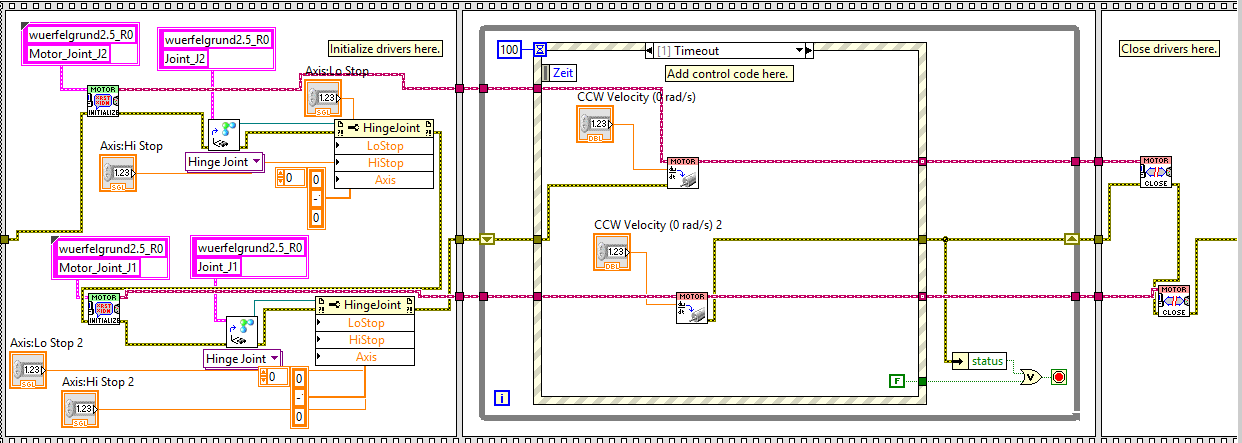

3D-Animation

Die synchron ablaufende 3D-Animation stellt das Ebenbild der mechanischen Handprothese dar.

Die Animation wird mit der grafischen Programmiersprache LabVIEW erarbeitet.

LabVIEW verwendet Funktionsblöcke (siehe Abbildung1), die es dank ihrer bereits enthaltenen Funktionen

ein erleichtertes Programmieren möglich machen. Somit muss man nicht bei „null anfangen“,

sondern man kann bereits auf gewisse Grundsteine aufbauen.

|

Bei dieser 3D-Animation wird zuerst ein Modell in SolidWorks erstellt, welches dann als wrl-Datei gespeichert wird.

Diese wrl-Datei ist für den Simulation Model Builder in LabVIEW kompatibel und kann, nachdem sie hochgeladen wurde,

weiterverarbeitet werden.

Es werden in dem Simulation Model Builder die Verbindungen („Joints“) zwischen den Komponenten des Modells gesetzt und

je nach Belieben können die Verbindungen mit Motoren versehen werden.

Diese Motoren der Verbindungen verleihen dem/der Programmierer/in die Fähigkeit die verschiedenen „Joints“ anzusteuern,

d.h. in diesem Fall sind sie eine wichtige Komponente um den einzelnen Finger biegen zu können.